In diesem Newsletter widmen wir uns dem Thema „künstliche Intelligenz“ (KI). Wir informieren über den ersten Rechtsrahmen zur Regulierung von KI, den AI Act der EU, insbesondere welche KI-Systeme in den Regelungsbereich des AI Act fallen, welche KI-Praktiken verboten sind, was eine Hochrisiko-KI ist und was beim Einsatz von KI in unterschiedlichen Rechtsgebieten, wie etwa Datenschutz, Urheberrechte und Haftungen zu beachten ist.

1. AI Act: Allgemeines und Anwendungsbereich

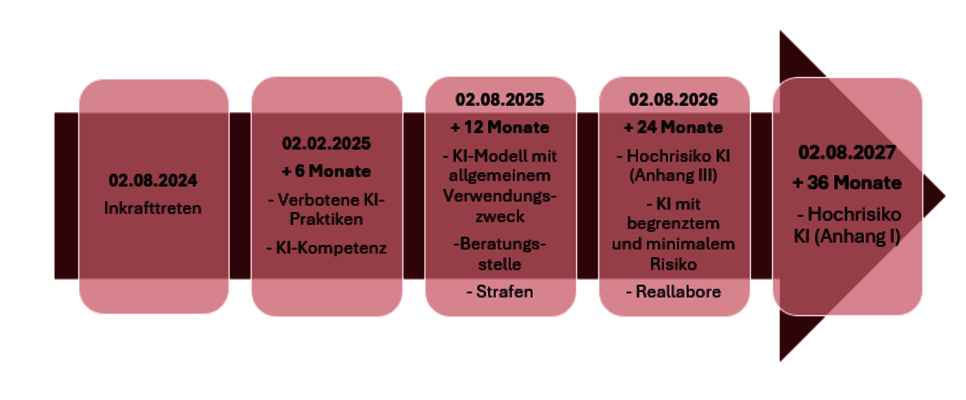

Am 01.08.2024 trat die EU-Verordnung 2024/1689 über künstliche Intelligenz (AI Act) in Kraft. Diese erlangt zeitlich gestaffelt Geltung.

Seit 02.02.2025 gelangen die ersten Bestimmungen, nämlich die Verpflichtungen zur KI-Kompetenz (Kapitel I, insbesondere Art 4) und Verbote bestimmter KI-Systeme (Kapitel II, Art 5) zur Anwendung.

Ab 02.08.2026 gilt der vollständige AI Act. Einzelne Bestimmungen finden auch erst später Anwendung:

Die EU-Kommission wird zu einzelnen Themenbereichen Leitlinien herausgeben. Die Leitlinien das „living Repository“ existieren bereits. |

Ziele des AI Act sind

ein einheitlicher Rechtsrahmen

eine „menschenzentrierte und vertrauenswürdige“ KI

Schutz von Gesundheit, Sicherheit und Grundrechten

Förderung von KI-Innovationen

Vermeidung schädlicher Auswirkungen von KI

Anwendungsbereich

Der Anwendungsbereich des AI Acts ist sehr weit. Er gilt für alle Unternehmen, die KI-Systeme in Verkehr bringen, in Betrieb nehmen, betreiben (= verwenden), einführen, handeln, entwickeln und/oder entwickeln lassen. Welche Maßnahmen konkret gesetzt werden müssen, hängt davon ab, welcher Risikostufe das genutzte KI-System angehört. Unterschieden wird zwischen "minimalen", "begrenzten", "hohen" und "inakzeptablen" Risikostufen.

Hat ein Akteur (= Anbieter, Produkthersteller, Betreiber, Bevollmächtigter, Einführer oder Händler eines KI-Systems) seinen Sitz in einem Drittstaat, so wird er von seinen Pflichten gem AI Act nicht entbunden, solange die KI für die EU bestimmt ist, also beabsichtigt wird, den erzeugten Output in der EU zu verwenden.

Ausnahmen vom Anwendungsbereich des AI Acts sind zB KI-Systeme, die:

ausschließlich für militärische Zwecke, Verteidigungszwecke oder Zwecke der nationalen Sicherheit verwendet werden,

nicht in der EU in Verkehr gebracht oder in Betrieb genommen werden,

ausschließlich zur wissenschaftlichen Forschung und Entwicklung genutzt werden,

zur Entwicklung von KI-Systemen dienen, bevor sie in Verkehr gebracht werden,

ausschließlich privat durch Einzelpersonen genutzt werden.

Der „Risikobasierte Ansatz“

Umfang und Inhalt der Vorschriften sind gekoppelt an die Risiken, die vom jeweiligen KI-System ausgehen. Die Umsetzung erfolgt durch eine Unterteilung der KI-Systeme in verschiedene Risikoklassen, die bestimmen, ob sie strengen oder weniger strengen Regeln unterliegen:

Verbotene KI-Systeme (Art 5 AI Act) -> Sie stellen ein inakzeptables Risiko dar und gelten als unvereinbar mit den EU-Grundrechten (zB manipulative KI-Systeme, Datenbanken zur Gesichts- oder Emotionserkennung).

Hochrisiko KI-Systeme (Art 6 ff AI Act) -> Anbieter und Betreiber von KI-Systemen mit hohem Risiko unterliegen umfassenden Verpflichtungen gem AI Act (siehe Punkt 5).

Bestimmte KI-Systeme mit begrenztem Risiko -> Dazu zählen insb klassische Chatbots, sie unterliegen vorwiegend Transparenzvorschriften.

KI-Systeme mit minimalem Risiko unterliegen keinen besonderen Verpflichtungen (zB Spamfilter).

Auch KI-Modelle mit allgemeinem Verwendungszweck (General Purpose Artificial Intelligence, GPAI) spielen im AI Act eine Rolle. Sie können für unterschiedlichste Zwecke herangezogen werden, die tatsächliche Endnutzung steht nicht fest. Auch sie unterliegen Verpflichtungen (Art 53 AI Act), insb. der Dokumentation von Systementwicklung und Trainingsinhalten und der Bereitstellung von Informationen für nachgelagerte Anbieter.

2. Klassifizierung von Künstlicher Intelligenz nach dem AI Act

Ein „KI-System“ ist ein „maschinengestütztes System, das für einen in unterschiedlichem Grade autonomen Betrieb ausgelegt ist, das nach seiner Betriebsaufnahme anpassungsfähig sein kann und das aus den erhaltenen Eingaben für explizite oder implizite Ziele ableitet, wie Ausgaben wie etwa Vorhersagen, Inhalte, Empfehlungen oder Entscheidungen erstellt werden, die physische oder virtuelle Umgebungen beeinflussen können;“ (Art 3 Z 1 AI Act).

In der Praxis muss demzufolge geprüft werden, ob

|

3. KI-Kompetenz: verpflichtendes KI-Training für Arbeitnehmer:innen nach Art 4 AI Act (seit 02.02.2025)

Für alle Unternehmen relevant sind die seit 02.02.2025 geltenden Bestimmungen zur KI-Kompetenz.

Art 4 AI Act verpflichtet Anbieter und Betreiber von KI-Systemen, dafür zu sorgen, dass ihr Personal und andere Personen, die in ihrem Auftrag mit Betrieb und Nutzung von KI-Systemen befassen, über ein ausreichendes Maß an Kenntnissen im Bereich der künstlichen Intelligenz verfügen (= KI-Kompetenz). Diese Kompetenz umfasst technische, rechtliche und ethische Kenntnisse, Risikobewusstsein und praktische Anwendungsfähigkeit. Zur Umsetzung dieser Vorgaben gibt es keine konkreten Vorgaben, wobei gem Art 4 Folgendes zu berücksichtigen ist:

technische Kenntnisse, Erfahrung und Ausbildung

Kontext, in dem die KI-Systeme eingesetzt werden

Personen oder Personengruppen, bei denen die KI-Systeme eingesetzt werden sollen

Aufgrund der weiten Anwendung dieser Regelung spielt auch die Risikostufe eine Rolle. Beschäftigt sich ein Unternehmen nur mit der Anwendung eines KI-Systems, befindet es sich grundsätzlich nur im begrenzten Risikobereich (zB Verwendung von Chatbots). Dementsprechend gestaltet sich auch eine Schulung anders als in einem Unternehmen, das KI-Systeme zB entwickelt und sich daher in einem höheren Risikobereich befindet.

Beispiele für KI-Kompetenzen, die vermittelt werden sollten:

grundlegendes Verständnis von KI-Systemen und digitaler Kompetenz, zB Kenntnisse über die Funktions- und Arbeitsweise von KI

Wissen über die korrekte Nutzung und Anwendung im Kontext des Unternehmens, zB durch Durchführung von Prompting-Workshops

Fähigkeit Vor- und Nachteile von KI und ethische Bedenken zu erkennen und KI-Ergebnisse dementsprechend zu beurteilen und kritisch zu hinterfragen, zB das Bestehen von Bias (= wenn KI-Systeme systematisch verzerrte Ergebnisse liefern, die bestimmte Gruppen oder Individuen ungerecht bevorzugen oder benachteiligen)

Kenntnisse relevanter rechtlicher Aspekte, zB Datenschutz, Arbeitsrecht, Urheberrecht

To-Dos: was hat ein Unternehmen zu tun? Unternehmen, die die Verpflichtung zur KI-Kompetenz trifft, sollten folgende Maßnahmen setzen:

|

4. Verbotene KI-Praktiken nach Art 5 AI Act (seit 02.02.2025)

Art 5 Abs 1 AI Act enthält einen abschließenden Katalog von KI-Praktiken, die als inakzeptabel zu qualifizieren und damit per se verboten sind.

Es wird auf das „Inverkehrbringen“, die „Inbetriebnahme“ und die „Verwendung“ von KI-Systemen, die verpönte Zielsetzungen verfolgen und/oder Schäden verwirklichen, abgestellt, um das Selbstbestimmungsrecht natürlicher Personen nicht zu beeinträchtigen und zentrale Grundrechte der Union nicht zu gefährden.

Verbotene Praktiken sind:

Verhaltensmanipulation und Täuschung

Ausnutzung gruppenspezifischer Vulnerabilität

„Social Scoring“ (= Bewertung oder Einstufung natürlicher Personen oder ganzer Personengruppen über einen bestimmten Zeitraum auf Grundlage ihres sozialen Verhaltens oder bekannter, abgeleiteter oder vorhergesagter persönlicher Eigenschaften oder Persönlichkeitsmerkmale)

„Predictive Policing“ (= Risikobewertung von Menschen in Bezug auf eine künftige Straftat auf der Grundlage von Profiling oder der Bewertung persönlicher Merkmale und Eigenschaften)

Erstellung und Erweiterung von Gesichtserkennungsdatenbanken

Emotionserkennung in Arbeits- oder Bildungseinrichtungen

biometrische Kategorisierung

Verwendung biometrischer Echtzeit-Fernidentifizierungssysteme zu Strafverfolgungszwecken

Art 5 AI Act gilt – wie die KI-Kompetenz – seit 02.02.2025.

Verstöße gegen Art 5 AI Act unterliegen einer höheren Strafdrohung -> Geldbußen von bis zu € 35 Mio bzw von bis zu 7 % des weltweiten Jahresumsatzes eines Unternehmens. Bevorzugt wird jener Betrag, der höher ist.

Um eine einheitliche und effektive Anwendung sicherzustellen, veröffentlichte die Europäische Kommission Leitlinien zu den verbotenen KI-Praktiken der künstlichen Intelligenz (KI) im Sinne des AI Acts.

5. Hochrisiko-KI (Art 6 ff AI Act): was versteht man darunter und was ist zu beachten?

KI-Systeme mit hohem Risiko und deren Regulierung stellen einen Kernteil des AI Acts dar. Für Hochrisiko-KI gelten besonders strenge Pflichten.

Bei Hochrisikosystemen wird zwischen produkt- und kontextbezogenen Risiken unterschieden:

Produktbezogene Risiken (Art 6 Abs 1 und Anhang I AI Act): Dabei handelt es sich um KI-Systeme, die ein Sicherheitsbauteil eines regulierten Produkts oder selbst ein solches Produkt sind (zB Sicherheitsbauteile in Maschinen, Medizinprodukte, Aufzüge, Seilbahnen, Kinderspielzeug etc).

Diese Vorschriften gelten ab 02.08.2027.

Kontextbezogene Risiken (Art 6 Abs 2 und Anhang III AI Act): sie bergen aufgrund ihrer Zweckbestimmung ein hohes Risiko, zB KI-Systeme zur Leistungsüberwachung von Arbeitnehmern, biometrische Fernidentifizierungssysteme oder Emotionserkennung.

Diese Vorschriften gelten ab 02.08.2026.

Maßstab für die Einstufung als Hochrisikosystem gem Anhang III AI Act ist stets eine erhebliche schädliche Auswirkung auf Gesundheit, Sicherheit und/oder Grundrechte von Personen in der EU. Der Hochrisiko-Charakter kann widerlegt werden.

Inverkehrbringen und Verwendung solcher KI-Systeme ist nur unter besonderen Auflagen erlaubt. Anbieter, Betreiber, Händler und Einführer von Hochrisiko-KI unterliegen umfangreichen Verpflichtungen.

Anbieter werden am stärksten in die Pflicht genommen, sie sind verpflichtet

ein Risikomanagementsystem zu implementieren,

eine Daten-Governance einzuführen,

technische Prozesse und Vorgänge und Ereignisse zu dokumentieren,

Betriebsanleitungen bereit- und Transparenz sicherzustellen,

menschliche Aufsicht zur Verfügung zu stellen,

sicherzustellen, dass das KI-System genaue, robuste und cybersichere Ergebnisse liefert,

ein Qualitätsmanagementsystem einzuführen,

Korrekturmaßnahmen und Informationspflichten zu ergreifen,

- das KI-System einem Konformitätsbewertungsverfahren zu unterziehen und

- vor der ersten Verwendung oder Bereitstellung zu registrieren,

- das KI- System nach Inverkehrbringen laufend zu überwachen.

Betreiber von Hochrisiko-KI sind verpflichtet

- das Hochrisiko-KI-Systems entsprechend der vom Anbieter bereitgestellten Betriebsanleitung zu verwenden, zu überwachen und Anbieter zu informieren,

- die menschliche Aufsicht qualifiziertem Personal zu übertragen.

ACHTUNG: Der Verpflichtung entsprechende KI-Kompetenz für Personal und andere beauftragte Personen sicherzustellen, unterliegen alle Risikostufen (siehe dazu Punkt 3)!

6. KI und Urheberrecht

Durch die Nutzung von KI stellen sich auch Fragen zum Urheberrecht. Dieses spielt insb. dann eine Rolle, wenn

urheberrechtlich geschützte Inhalte für das Training von KI-Anwendungen verwendet werden oder

von KI generierte Ergebnisse verwendet werden.

Urheberrecht und Training

Unter „Training“ versteht man den (Weiter-)Aufbau der Lösungskompetenz eines KI-Systems mithilfe von Daten. Dabei stellt sich die Frage, ob Urheberrechte verletzt werden, wenn für dieses Training urheberrechtlich geschützte Werke verwendet werden. Durch die Nutzung solcher Daten kann nämlich eine Vervielfältigung iSv § 15 Urheberrechtsgesetz (UrhG) vorliegen, gegen welche urheberrechtlich vorgegangen werden kann.

ACHTUNG: Für Nutzer von KI ist das insbesondere kritisch, wenn ein Prompt mit urheberrechtlich geschützten Daten eingefügt wird, der die KI weitertrainiert. Der Nutzer muss idF sicherstellen, dass

er über die erforderlichen Rechte verfügt oder

die Inhalte nicht zum Training verwendet werden.

Um als Rechteinhaber zu verhindern, dass eigene, im Internet veröffentlichte Texte als Trainingsdaten für KI verwendet werden, kann ein Vorbehalt (Opt-out) erklärt werden.

Urheberrecht und Ergebnisse der KI

Inhalte, die nur auf KI basieren, sind grundsätzlich nicht urheberrechtlich geschützt. Urheberrechtlich geschützt werden nämlich nur „eigentümliche geistige Schöpfungen“ auf den Gebieten der Literatur, der Tonkunst, der bildenden Kunst und der Filmkust (§ 1 Abs 1 UrhG). Es kommt auf die Schöpfung durch einen „menschlichen Geist“ an. Schöpfungen einer Maschine können daher keinen Urheberschutz genießen. Es kommt zu Abgrenzungsproblemen vor allem, wenn die Basis des Werkes vom Nutzer kommt und die KI bloß als Hilfsmittel verwendet wird. In diesem Fall könnte eine Urheberschaft des Nutzers in Frage kommen.

Wird ein durch KI generierter Text (zB durch ChatGPT) durch den Nutzer weiterbearbeitet und entsteht durch die Bearbeitung eine eigentümliche geistige Schöpfung, kann es sich um eine urheberrechtlich geschützte Leistung handeln.

ACHTUNG: Enthält das Ergebnis eines Prompts, in dem bereits urheberrechtlich geschützte Werke verwendet wurden, ganz oder teilweise eine Kopie des geschützten Inhalts, kann es auch beim Ergebnis zu Urheberrechtsverletzungen kommen!

Urheberrechtliches aus dem AI Act

Aus den Erwägungsgründen 105 bis 109 und Art 53 AI Act geht hervor, dass Anbieter von KI-Modellen mit allgemeinem Verwendungszweck (GPAI) besonderen urheberrechtlichen Pflichten unterliegen. Sie müssen eine Strategie zur Einhaltung des EU-Urheberrechts implementieren, selbst wenn die KI nicht in der EU trainiert wird und keine urheberrechtlich relevanten Handlungen in der EU gesetzt werden.

Art 50 AI verpflichtet Anbieter und Betreiber von KI zur Kennzeichnung der Verwendung von KI, um die Erkennbarkeit des Einsatzes von KI zu erleichtern.

7. KI und Datenschutz

Bei der Entwicklung und im Betrieb von KI-Systemen und -Modellen, insbesondere bei kontextbezogenenHochrisiko-KI-Systeme (zB zur Leistungsüberwachung, siehe oben Punkt 5) und verbotenen Praktiken (zB Verhaltensmanipulation, siehe oben Punkt 4) spielen personenbezogene Daten eine zentrale Rolle.

AI Act und Datenschutz-Grundverordnung (DSGVO) sowie andere Vorschriften zum Schutz personenbezogener Daten sind parallel zu beachten. Dadurch können Überschneidungen entstehen. Daher erarbeitet der Europäische Datenschutzausschuss (EDSA) derzeit Leitlinien zum Zusammenspiel von AI Act und DSGVO. Darüber hinaus ist eine Zusammenarbeit zwischen den Datenschutz-Aufsichtsbehörden und den Marktüberwachungsbehörden vorgesehen.

Für KI sind bestimmte datenschutzrechtliche Bestimmungen zur Rechtmäßigkeit und Zulässigkeit der Verarbeitung und zu Betroffenenrechten von besonderer Bedeutung:

Die Verarbeitung der personenbezogenen Daten muss den Verarbeitungsgrundsätzen gem Art 5 Abs 1 DSGVO entsprechen, und es muss ein Erlaubnistatbestand des Art 6 Abs 1 DSGVO erfüllt sein.

Bei der Eingabe personenbezogene Daten in ein KI-System ist also höchste Vorsicht geboten!

Für das Trainieren von KI-Systemen ist die Verarbeitung personenbezogener Daten von enormer Bedeutung. Unter gewissen Voraussetzungen dürfen diese, für einen bestimmten Zweck erhobenen Daten, für andere, gleichartige Zwecke weiterverarbeitet werden.

Art 59 AI Act (siehe unten: Ausnahmen) nimmt darauf Rücksicht und schafft eine eigene Rechtsgrundlage für die Entwicklung von KI-Systemen im öffentlichen Interesse innerhalb eines KI-Reallabors.

Auch Betroffenenrechte sind zu gewährleisten. Neben Informations- und Auskunftsrechten ist insbesondere das Recht, nicht einer ausschließlich automatisierten Entscheidung unterworfen zu sein (Art 22 DSGVO) maßgebend: zB Profiling ohne menschliches Zutun. Diese ausschließlich automatisierte Entscheidung darf sich nicht auf die Rechtsposition der betroffenen Person auswirken.

Zwei Ausnahmen, bei denen der AI Act den datenschutzrechtlichen Regelungen vorgeht, sind

Art 10 Abs 5 AI Act: ausnahmsweise dürfen sensible Daten (=besondere Kategorien personenbezogener Daten) für Hochrisiko-Systeme verarbeitet werden, sofern dies zur Erkennung und Vermeidung von Diskriminierung notwendig ist.

Art 59 AI Act: rechtmäßig für andere Zwecke erhobene personenbezogener Daten dürfen zur Entwicklung von KI-Systemen im öffentlichen Interesse innerhalb eines KI-Reallabors verarbeitet werden.

8. KI und Haftung

Für Schadenersatzansprüche gelten die allgemeinen Voraussetzungen des zivilrechtlichen Schadenersatzrechts, wonach Schaden, Kausalität, Rechtswidrigkeit und Verschulden gegeben sein müssen.

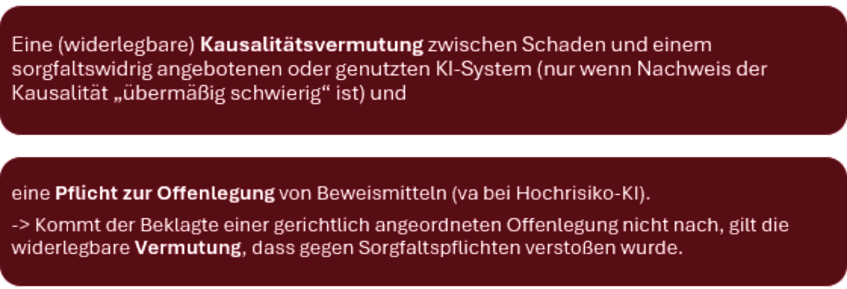

KI-Haftungs-Richtlinie - Entwurf

Der AI Act enthältkeine eigenen Haftungsregelungen, jedoch gibt es Pläne für eine KI-Haftungs-Richtlinie. Sie soll insbesondere die Beweisführung erleichtern, da es für Kläger schwer sein kann zu beweisen, dass zwischen einer Handlung (zB Verletzung des AI Acts) und dem Schaden ein Zusammenhang besteht. Darüber hinaus kann ein solcher Beweis auch einen hohen Kostenfaktor darstellen, da möglicherweise das Einholen komplexer technischer Gutachten notwendig ist.

Überblicksmäßig sind in der KI-Haftungs-Richtlinie folgende Regelungen vorgesehen:

ACHTUNG: die KI-Haftungs-Richtlinie befindet sich noch im Entwurfstadium.

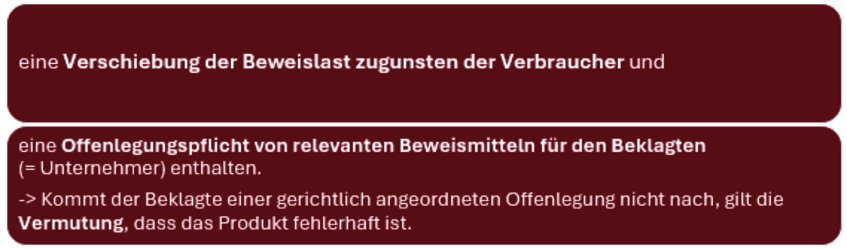

Produkthaftungs-Richtlinie

Weitere Regelungen enthält die neue Produkthaftungs-Richtlinie (EU)2024/2853, welche am 08.12.2024 in Kraft trat. Sie befasst sich mit der verschuldensunabhängigen Haftung eines Herstellers für Folgeschäden aufgrund fehlerhafter Produkte und erweiterte den Produkt-, Schadens- und Fehlerbegriff in Hinblick auf Software und KI-Systeme, dh Hersteller von KI-Systemen kommen alsHaftungsadressaten in Betracht.

Um Verbrauchern die Rechtsdurchsetzung zu erleichtern ist ua

Beide Richtlinien behandeln die außervertragliche (=deliktische) Haftung. Für vertragliche Schadenersatzansprüche ist das allgemeine Zivilrecht anzuwenden. Fehlfunktionen eines KI-Systems sind als Mängel iSd Gewährleistungsrechts anzusehen.

9. Seminare

Frau Mag Sylvia Unger hält im 1. Halbjahr 2025 folgende Seminare:

Präsenzseminar: „Arbeitsrecht für Führungskräfte“

Am 25.06.2025 findet im Hotel Sans Souci Wien das Präsenzseminar „Arbeitsrecht für Führungskräfte“, das für alle Branchen geeignet ist, statt. Nähere Informationen finden Sie hier: https://www.weka-akademie.at/arbeitsrecht-fur-fuhrungskrafte/

Austrian Payment Academy/APAc – Grundkurse 2025 (hybrid)

Die APAc (Austrian Payment Academy) ist ein Ausbildungsangebot für alle, die im Zahlungsverkehr tätig sind oder einen umfassenden Einblick in die technologiegetriebene dynamische Payment Branche erhalten möchten. Frau Mag Unger trägt das Modul IV „Legal, Compliance“ vor und erläutert die rechtlichen Rahmenbedingungen des Zahlungsverkehrs. Der nächste Grundkurs startet am 24.04.2025. Nähere Informationen unter https://paymentacademy.at/angebot.

Präsenzseminar: „Zahlungsverkehr, Zahlungsdienste, Zahlungskonto“

Am 01.04.2025 findet das Fachseminar "Zahlungsverkehr, Zahlungsdienste, Zahlungskonto! Aktuelle Regulatorik und Zivilrecht! – Aktuelle Judikatur des EuGH und des OGH" des Finanzverlages statt. Nähere Informationen finden Sie hier: https://www.finanzverlag.at/events/zahlungsverkehr-zahlungsdienste-zahlungskonto/